本文介紹如何在springboot項目中集成kafka收發message。

kafka是一種高吞吐量的分布式發布訂閱消息系統,有如下特性: 通過o(1)的磁盤數據結構提供消息的持久化,這種結構對于即使數以tb的消息存儲也能夠保持長時間的穩定性能。高吞吐量:即使是非常普通的硬件kafka也可以支持每秒數百萬的消息。支持通過kafka服務器和消費機集群來分區消息。支持hadoop并行數據加載。

安裝kafka

因為安裝kafka需要zookeeper的支持,所以windows安裝時需要將zookeeper先安裝上,然后將kafka安裝好就可以了。 下面我給出mac安裝的步驟以及需要注意的點吧,windows的配置除了所在位置不太一樣其他幾乎沒什么不同。

|

1

|

brew install kafka |

對,就是這么簡單,mac上一個命令就可以搞定了,這個安裝過程可能需要等一會兒,應該是和網絡狀況有關系。安裝提示信息可能有錯誤消息,如"error: could not link: /usr/local/share/doc/homebrew" 這個沒關系,自動忽略掉了。 最終我們看到下面的樣子就成功咯。

==> summary �/usr/local/cellar/kafka/1.1.0: 157 files, 47.8mb

安裝的配置文件位置如下,根據自己的需要修改端口號什么的就可以了。

安裝的zoopeeper和kafka的位置 /usr/local/cellar/

配置文件 /usr/local/etc/kafka/server.properties /usr/local/etc/kafka/zookeeper.properties

啟動zookeeper

啟動kafka

./bin/kafka-server-start /usr/local/etc/kafka/server.properties &

為kafka創建topic,topic 名為test,可以配置成自己想要的名字,回頭再代碼中配置正確就可以了。

1、先解決依賴

springboot相關的依賴我們就不提了,和kafka相關的只依賴一個spring-kafka集成包

|

1

2

3

4

5

|

<dependency> <groupid>org.springframework.kafka</groupid> <artifactid>spring-kafka</artifactid> <version>1.1.1.release</version> </dependency> |

這里我們先把配置文件展示一下

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

#============== kafka ===================kafka.consumer.zookeeper.connect=10.93.21.21:2181kafka.consumer.servers=10.93.21.21:9092kafka.consumer.enable.auto.commit=truekafka.consumer.session.timeout=6000kafka.consumer.auto.commit.interval=100kafka.consumer.auto.offset.reset=latestkafka.consumer.topic=testkafka.consumer.group.id=testkafka.consumer.concurrency=10kafka.producer.servers=10.93.21.21:9092kafka.producer.retries=0kafka.producer.batch.size=4096kafka.producer.linger=1kafka.producer.buffer.memory=40960 |

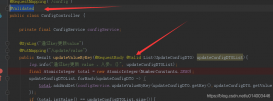

2、configuration:kafka producer

1)通過@configuration、@enablekafka,聲明config并且打開kafkatemplate能力。

2)通過@value注入application.properties配置文件中的kafka配置。

3)生成bean,@bean

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

|

package com.kangaroo.sentinel.collect.configuration;import java.util.hashmap;import java.util.map;import org.apache.kafka.clients.producer.producerconfig;import org.apache.kafka.common.serialization.stringserializer;import org.springframework.beans.factory.annotation.value;import org.springframework.context.annotation.bean;import org.springframework.context.annotation.configuration;import org.springframework.kafka.annotation.enablekafka;import org.springframework.kafka.core.defaultkafkaproducerfactory;import org.springframework.kafka.core.kafkatemplate;import org.springframework.kafka.core.producerfactory;@configuration@enablekafkapublic class kafkaproducerconfig { @value("${kafka.producer.servers}") private string servers; @value("${kafka.producer.retries}") private int retries; @value("${kafka.producer.batch.size}") private int batchsize; @value("${kafka.producer.linger}") private int linger; @value("${kafka.producer.buffer.memory}") private int buffermemory; public map<string, object> producerconfigs() { map<string, object> props = new hashmap<>(); props.put(producerconfig.bootstrap_servers_config, servers); props.put(producerconfig.retries_config, retries); props.put(producerconfig.batch_size_config, batchsize); props.put(producerconfig.linger_ms_config, linger); props.put(producerconfig.buffer_memory_config, buffermemory); props.put(producerconfig.key_serializer_class_config, stringserializer.class); props.put(producerconfig.value_serializer_class_config, stringserializer.class); return props; } public producerfactory<string, string> producerfactory() { return new defaultkafkaproducerfactory<>(producerconfigs()); } @bean public kafkatemplate<string, string> kafkatemplate() { return new kafkatemplate<string, string>(producerfactory()); }} |

實驗我們的producer,寫一個controller。想topic=test,key=key,發送消息message

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

|

package com.kangaroo.sentinel.collect.controller;import com.kangaroo.sentinel.common.response.response;import com.kangaroo.sentinel.common.response.resultcode;import org.slf4j.logger;import org.slf4j.loggerfactory;import org.springframework.beans.factory.annotation.autowired;import org.springframework.kafka.core.kafkatemplate;import org.springframework.web.bind.annotation.*;import javax.servlet.http.httpservletrequest;import javax.servlet.http.httpservletresponse;@restcontroller@requestmapping("/kafka")public class collectcontroller { protected final logger logger = loggerfactory.getlogger(this.getclass()); @autowired private kafkatemplate kafkatemplate; @requestmapping(value = "/send", method = requestmethod.get) public response sendkafka(httpservletrequest request, httpservletresponse response) { try { string message = request.getparameter("message"); logger.info("kafka的消息={}", message); kafkatemplate.send("test", "key", message); logger.info("發送kafka成功."); return new response(resultcode.success, "發送kafka成功", null); } catch (exception e) { logger.error("發送kafka失敗", e); return new response(resultcode.exception, "發送kafka失敗", null); } }} |

3、configuration:kafka consumer

1)通過@configuration、@enablekafka,聲明config并且打開kafkatemplate能力。

2)通過@value注入application.properties配置文件中的kafka配置。

3)生成bean,@bean

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

|

package com.kangaroo.sentinel.collect.configuration;import org.apache.kafka.clients.consumer.consumerconfig;import org.apache.kafka.common.serialization.stringdeserializer;import org.springframework.beans.factory.annotation.value;import org.springframework.context.annotation.bean;import org.springframework.context.annotation.configuration;import org.springframework.kafka.annotation.enablekafka;import org.springframework.kafka.config.concurrentkafkalistenercontainerfactory;import org.springframework.kafka.config.kafkalistenercontainerfactory;import org.springframework.kafka.core.consumerfactory;import org.springframework.kafka.core.defaultkafkaconsumerfactory;import org.springframework.kafka.listener.concurrentmessagelistenercontainer;import java.util.hashmap;import java.util.map;@configuration@enablekafkapublic class kafkaconsumerconfig { @value("${kafka.consumer.servers}") private string servers; @value("${kafka.consumer.enable.auto.commit}") private boolean enableautocommit; @value("${kafka.consumer.session.timeout}") private string sessiontimeout; @value("${kafka.consumer.auto.commit.interval}") private string autocommitinterval; @value("${kafka.consumer.group.id}") private string groupid; @value("${kafka.consumer.auto.offset.reset}") private string autooffsetreset; @value("${kafka.consumer.concurrency}") private int concurrency; @bean public kafkalistenercontainerfactory<concurrentmessagelistenercontainer<string, string>> kafkalistenercontainerfactory() { concurrentkafkalistenercontainerfactory<string, string> factory = new concurrentkafkalistenercontainerfactory<>(); factory.setconsumerfactory(consumerfactory()); factory.setconcurrency(concurrency); factory.getcontainerproperties().setpolltimeout(1500); return factory; } public consumerfactory<string, string> consumerfactory() { return new defaultkafkaconsumerfactory<>(consumerconfigs()); } public map<string, object> consumerconfigs() { map<string, object> propsmap = new hashmap<>(); propsmap.put(consumerconfig.bootstrap_servers_config, servers); propsmap.put(consumerconfig.enable_auto_commit_config, enableautocommit); propsmap.put(consumerconfig.auto_commit_interval_ms_config, autocommitinterval); propsmap.put(consumerconfig.session_timeout_ms_config, sessiontimeout); propsmap.put(consumerconfig.key_deserializer_class_config, stringdeserializer.class); propsmap.put(consumerconfig.value_deserializer_class_config, stringdeserializer.class); propsmap.put(consumerconfig.group_id_config, groupid); propsmap.put(consumerconfig.auto_offset_reset_config, autooffsetreset); return propsmap; } @bean public listener listener() { return new listener(); }} |

new listener()生成一個bean用來處理從kafka讀取的數據。listener簡單的實現demo如下:只是簡單的讀取并打印key和message值

@kafkalistener中topics屬性用于指定kafka topic名稱,topic名稱由消息生產者指定,也就是由kafkatemplate在發送消息時指定。

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

|

package com.kangaroo.sentinel.collect.configuration;import org.apache.kafka.clients.consumer.consumerrecord;import org.slf4j.logger;import org.slf4j.loggerfactory;import org.springframework.kafka.annotation.kafkalistener;public class listener { protected final logger logger = loggerfactory.getlogger(this.getclass()); @kafkalistener(topics = {"test"}) public void listen(consumerrecord<?, ?> record) { logger.info("kafka的key: " + record.key()); logger.info("kafka的value: " + record.value().tostring()); }} |

tips:

1)我沒有介紹如何安裝配置kafka,配置kafka時最好用完全bind網絡ip的方式,而不是localhost或者127.0.0.1

2)最好不要使用kafka自帶的zookeeper部署kafka,可能導致訪問不通。

3)理論上consumer讀取kafka應該是通過zookeeper,但是這里我們用的是kafkaserver的地址,為什么沒有深究。

4)定義監聽消息配置時,group_id_config配置項的值用于指定消費者組的名稱,如果同組中存在多個監聽器對象則只有一個監聽器對象能收到消息。

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持服務器之家。

原文鏈接:https://www.cnblogs.com/kangoroo/p/7353330.html