動機

我們花費大量的時間將數據從普通的交換格式(比如CSV),遷移到像數組、數據庫或者二進制存儲等高效的計算格式。更糟糕的是,許多人沒有將數據遷移到高效的格式,因為他們不知道怎么(或者不能)為他們的工具管理特定的遷移方法。

你所選擇的數據格式很重要,它會強烈地影響程序性能(經驗規律表明會有10倍的差距),以及那些輕易使用和理解你數據的人。

當提倡Blaze項目時,我經常說:“Blaze能幫助你查詢各種格式的數據。”這實際上是假設你能夠將數據轉換成指定的格式。

進入into項目

into函數能在各種數據格式之間高效的遷移數據。這里的數據格式既包括內存中的數據結構,比如:

列表、集合、元組、迭代器、numpy中的ndarray、pandas中的DataFrame、dynd中的array,以及上述各類的流式序列。

也包括存在于Python程序之外的持久化數據,比如:

CSV、JSON、行定界的JSON,以及以上各類的遠程版本

HDF5 (標準格式與Pandas格式皆可)、 BColz、 SAS、 SQL 數據庫 ( SQLAlchemy支持的皆可)、 Mongo

into項目能在上述數據格式的任意兩個格式之間高效的遷移數據,其原理是利用一個成對轉換的網絡(該文章底部有直觀的解釋)。

如何使用它

into函數有兩個參數:source和target。它將數據從source轉換成target。source和target能夠使用如下的格式:

Target Source Example

Object Object A particular DataFrame or list

String String ‘file.csv', ‘postgresql://hostname::tablename'

Type Like list or pd.DataFrame

所以,下邊是對into函數的合法調用:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

>>> into(list, df) # create new list from Pandas DataFrame >>> into([], df) # append onto existing list >>> into('myfile.json', df) # Dump dataframe to line-delimited JSON >>> into(Iterator, 'myfiles.*.csv') # Stream through many CSV files >>> into('postgresql://hostname::tablename', df) # Migrate dataframe to Postgres >>> into('postgresql://hostname::tablename', 'myfile.*.csv') # Load CSVs to Postgres >>> into('myfile.json', 'postgresql://hostname::tablename') # Dump Postgres to JSON >>> into(pd.DataFrame, 'mongodb://hostname/db::collection') # Dump Mongo to DataFrame |

Note that into is a single function. We're used to doing this with various to_csv, from_sql methods on various types. The into api is very small; Here is what you need in order to get started:

注意,into函數是一個單一的函數。雖然我們習慣于在各種類型上使用to_csv, from_sql等方法來完成這樣的功能,但接口into非常簡單。開始使用into函數前,你需要:

|

1

2

3

|

$ pip install into >>> from into import into |

在Github上查看into工程。

實例

現在我們展示一些更深層次的相同的實例。

將Python中的list類型轉換成numpy中的array類型

|

1

2

3

4

5

|

>>> import numpy as np >>> into(np.ndarray, [1, 2, 3]) array([1, 2, 3]) |

加載CSV文件,并轉換成Python中的list類型

|

1

2

3

4

5

6

7

8

9

10

11

|

>>> into(list, 'accounts.csv') [(1, 'Alice', 100), (2, 'Bob', 200), (3, 'Charlie', 300), (4, 'Denis', 400), (5, 'Edith', 500)] |

將CSV文件轉換成JSON格式

|

1

2

3

4

5

6

7

8

9

10

11

12

13

|

>>> into('accounts.json', 'accounts.csv') $ head accounts.json {"balance": 100, "id": 1, "name": "Alice"} {"balance": 200, "id": 2, "name": "Bob"} {"balance": 300, "id": 3, "name": "Charlie"} {"balance": 400, "id": 4, "name": "Denis"} {"balance": 500, "id": 5, "name": "Edith"} |

將行定界的JSON格式轉換成Pandas中的DataFrame格式

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

>>> import pandas as pd >>> into(pd.DataFrame, 'accounts.json') balance id name 0 100 1 Alice 1 200 2 Bob 2 300 3 Charlie 3 400 4 Denis 4 500 5 Edith |

它是如何工作的?

格式轉換是有挑戰性的。任意兩個數據格式之間的健壯、高效的格式轉換,都充滿了特殊情況和奇怪的庫。常見的解決方案是通過一個通用格式,例如DataFrame或流內存列表、字典等,進行格式轉換。(見dat)或者通過序列化格式,例如ProtoBuf或Thrift,進行格式轉換。這些都是很好的選擇,往往也是你想要的。然而有時候這樣的轉換是比較慢的,特別是當你在實時計算系統上轉換,或面對苛刻的存儲解決方案時。

考慮一個例子,在numpy.recarray和pandas.DataFrame之間進行數據遷移。我們可以非常快速地,適當地遷移這些數據。數據的字節不需要更改,只更改其周圍的元數據即可。我們不需要將數據序列化到一個交換格式,或轉換為中間的純Python對象。

考慮從CSV文件遷移數據到一個PostgreSQL數據庫。通過SQLAlchemy(注:一個Python環境下的數據庫工具箱)使用Python迭代器,我們的遷移速度不太可能超過每秒2000條記錄。然而使用PostgreSQL自帶的CSV加載器,我們的遷移速度可以超過每秒50000條記錄。花費一整晚的時間和花費一杯咖啡的時間進行數據遷移,是有很大區別的。然而這需要我們在特殊情況下,能足夠靈活的使用特殊代碼。

專門的兩兩互換工具往往比通用解決方案快一個數量級。

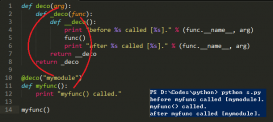

Into項目是那些成對地數據遷移組成的一個網絡。我們利用下圖展示這個網絡:

每個節點是一種數據格式。每個定向的邊是一個在兩種數據格式之間轉換數據的函數。into函數的一個調用,可能會遍歷多個邊和多個中間格式。例如,當我們將CSV文件遷移到Mongo數據庫時,我們可以采取以下路徑:

?將CSV文件加載到DataFrame中(利用pandas.read_csv)

?然后轉換為np.recarray(利用DataFrame.to_records)

?接著轉換為一個Python的迭代器類型(利用np.ndarray.tolist)

?最終轉換成Mongo中的數據(利用pymongo.Collection.insert)

或者我們可以使用MongoDB自帶的CSV加載器,編寫一個特殊函數,用一個從CSV到Mongo的定向邊縮短整個處理過程。

為了找到最有效的路線,我們利用相對成本(引入權重的ad-hoc)給這個網絡的所有邊賦予權重值。然后我們使用networkx找到最短路徑,進而進行數據遷移。如果某個邊由于某種原因失敗了(引發NotImplementedError),我們可以自動重新尋找路徑。這樣我們的遷移方法是既高效又健壯的。

注意,我們給某些節點涂上紅色。這些節點的數據量可以大于內存。當我們在兩個紅色節點之間進行數據遷移時(輸入和輸出的數據量都可能大于內存),我們限制我們的路徑始終在紅色子圖中,以確保遷移路徑中間的數據不會溢出。需要注意的一種格式是chunks(…),例如chunks(DataFrame)是一個可迭代的,在內存中的DataFrames。這個方便的元格式允許我們在大數據上使用緊湊的數據結構,例如numpy的arrays和pandas的DataFrames,同時保持在內存中數據的只有幾十兆字節。

這種網絡化的方法允許開發者對于特殊情況編寫專門的代碼,同時確信這段代碼只在正確的情況下使用。這種方法允許我們利用一個獨立的、可分離的方式處理一個非常復雜的問題。中央調度系統讓我們保持頭腦清醒。

歷史

很久以前,我寫過into鏈接到Blaze的文章,然后我立即就沉默了。這是因為舊的實現方法(網絡方法之前)很難擴展或維護,也沒有準備好進入其黃金期。

我很滿意這個網絡。意想不到的應用程序經常能夠正常運行,into工程現在也準備好進入其黃金期了。Into工程可以通過conda和pip得到,而獨立于Blaze。它主要的依賴為NumPy、Pandas和NetworkX,所以對于閱讀我博客的大部分人來說,它算是相對輕量級的。如果你想利用一些性能更好的格式,例如HDF5,你將同樣需要安裝這些庫(pro-tip,使用conda安裝)。

如何開始使用into函數

你應該下載一個最近版本的into工程。

|

1

2

3

4

5

|

$ pip install --upgrade git+https://github.com/ContinuumIO/into or $ conda install into --channel blaze |

然后你可能想要通過該教程的上半部分,或者閱讀該文檔。

又或者不閱讀任何東西,只是試一試。我的希望是,這個接口很簡單(只有一個函數!),用戶可以自然地使用它。如果你運行中出現了問題,那么我很愿意在[email protected]中聽到它們。