本文介紹一個將911襲擊及后續(xù)影響相關(guān)新聞文章的主題可視化的項目。我將介紹我的出發(fā)點,實現(xiàn)的技術(shù)細節(jié)和我對一些結(jié)果的思考。

簡介

近代美國歷史上再沒有比911襲擊影響更深遠的事件了,它的影響在未來還會持續(xù)。從事件發(fā)生到現(xiàn)在,成千上萬主題各異的文章付梓。我們怎樣能利用數(shù)據(jù)科學的工具來探索這些主題,并且追蹤它們隨著時間的變化呢?

靈感

首先提出這個問題的是一家叫做Local Projects的公司,有人委任它們?yōu)榧~約的國家911博物館設(shè)置一個展覽。他們的展覽,Timescape,將事件的主題和文章可視化之后投影到博物館的一面墻上。不幸的是,由于考慮到官僚主義的干預和現(xiàn)代人的三分鐘熱度,這個展覽只能展現(xiàn)很多主題,快速循環(huán)播放。Timescape的設(shè)計給了我啟發(fā),但是我想試著更深入、更有交互性,讓每個能接入互聯(lián)網(wǎng)的人都能在空閑時觀看。

這個問題的關(guān)鍵是怎么講故事。每篇文章都有不同的講故事角度,但是有線索通過詞句將它們聯(lián)系到一起。”Osama bin Laden”、 “Guantanamo Bay”、”Freedom”,還有更多詞匯組成了我模型的磚瓦。

獲取數(shù)據(jù)

所有來源當中,沒有一個比紐約時報更適合講述911的故事了。他們還有一個神奇的API,允許在數(shù)據(jù)庫中查詢關(guān)于某一主題的全部文章。我用這個API和其他一些Python網(wǎng)絡(luò)爬蟲以及NLP工具構(gòu)建了我的數(shù)據(jù)集。

爬取過程是如下這樣的:

- 調(diào)用API查詢新聞的元數(shù)據(jù),包括每篇文章的URL。

- 給每個URL發(fā)送GET請求,找到HTML中的正文文本,提取出來。

- 清理文章文本,去除停用詞和標點

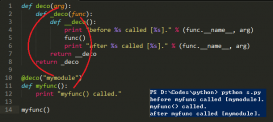

我寫了一個Python腳本自動做這些事,并能夠構(gòu)建一個有成千上萬文章的數(shù)據(jù)集。也許這個過程中最有挑戰(zhàn)性的部分是寫一個從HTML文檔里提取正文的函數(shù)。近幾十年來,紐約時報不時也更改了他們HTML文檔的結(jié)構(gòu),所以這個抽取函數(shù)取決于笨重的嵌套條件語句:

|

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

|

# s is a BeautifulSoup object containing the HTML of the pageif s.find('p', {'itemprop': 'articleBody'}) is not None: paragraphs = s.findAll('p', {'itemprop': 'articleBody'}) story = ' '.join([p.text for p in paragraphs])elif s.find('nyt_text'): story = s.find('nyt_text').textelif s.find('div', {'id': 'mod-a-body-first-para'}): story = s.find('div', {'id': 'mod-a-body-first-para'}).text story += s.find('div', {'id': 'mod-a-body-after-first-para'}).textelse: if s.find('p', {'class': 'story-body-text'}) is not None: paragraphs = s.findAll('p', {'class': 'story-body-text'}) story = ' '.join([p.text for p in paragraphs]) else: story = '' |

文檔向量化

在我們應用機器學習算法之前,我們要將文檔向量化。感謝scikit-learn的IT-IDF Vectorizer模塊,這很容易。只考慮單個詞是不夠的,因為我的數(shù)據(jù)集里并不缺一些重要的名字。所以我選擇使用n-grams,n取了1到3。讓人高興的是,實現(xiàn)多個n-gram和實現(xiàn)單獨關(guān)鍵詞一樣簡單,只需要簡單地設(shè)置一下Vectorizer的參數(shù)。

|

1

2

3

|

vec = TfidfVectorizer(max_features=max_features, ngram_range=(1, 3), max_df=max_df) |

開始的模型里,我設(shè)置max_features(向量模型里詞或詞組的最大數(shù)量)參數(shù)為20000或30000,在我計算機的計算能力之內(nèi)。但是考慮到我還加入了2-gram和3-gram,這些組合會導致特征數(shù)量的爆炸(這里面很多特征也很重要),在我的最終模型里我會提高這個數(shù)字。

用NMF做主題模型

非負矩陣分解(Non-negative Matrix Factorization,或者叫NMF),是一個線性代數(shù)優(yōu)化算法。它最具魔力的地方在于不用任何闡釋含義的先驗知識,它就能提取出關(guān)于主題的有意義的信息。數(shù)學上它的目標是將一個nxm的輸入矩陣分解成兩個矩陣,稱為W和H,W是nxt的文檔-主題矩陣,H是txm的主題-詞語矩陣。你可以發(fā)現(xiàn)W和H的點積與輸入矩陣形狀一樣。實際上,模型試圖構(gòu)建W和H,使得他們的點積是輸入矩陣的一個近似。這個算法的另一個優(yōu)點在于,用戶可以自主選擇變量t的值,代表生成主題的數(shù)量。

再一次地,我把這個重要的任務交給了scikit-learn,它的NMF模塊足夠處理這個任務。如果我在這個項目上投入更多時間,我也許會找一些更高效的NMF實現(xiàn)方法,畢竟它是這個項目里最復雜耗時的過程。實現(xiàn)過程中我產(chǎn)生了一個主意,但沒實現(xiàn)它,是一個熱啟動的問題。那樣可以讓用戶用一些特定的詞來填充H矩陣的行,從而在形成主題的過程中給系統(tǒng)一些領(lǐng)域知識。不管怎么樣,我只有幾周時間完成整個項目。還有很多其他的事需要我更多的精力。

主題模型的參數(shù)

因為主題模型是整個項目的基石,我在構(gòu)建過程中做的決定對最終成果有很大影響。我決定輸入模型的文章為911事件發(fā)生18個月以后的。在這個時間段喧囂不再,所以這段時間出現(xiàn)的主題的確是911事件的直接結(jié)果。在向量化的階段,開始幾次運行的規(guī)模受限于我的計算機。20或者30個主題的結(jié)果還不錯,但是我想要包含更多結(jié)果的更大模型。

我最終的模型使用了100000個向量詞匯和大約15000篇文章。我設(shè)置了200個主題,所以NMF算法需要處理15000×100000, 15000×200和200×100000規(guī)模的矩陣。逐漸變換后兩個矩陣來擬合第一個矩陣。

完成模型

最終模型矩陣完成之后,我查看每個主題并檢查關(guān)鍵詞(那些在主題-詞語矩陣里有最高概率值的)。我給每個主題一個特定的名字(在可視化當中可以用),并決定是否保留這個主題。一些主題由于和中心話題無關(guān)被刪除了(例如本地體育);還有一些太寬泛(關(guān)于股票市場或者政治的主題);還有一些太特定了,很可能是NMF算法的誤差(一系列來源于同一篇文章中的有關(guān)聯(lián)的3-grams)

這個過程之后我有了75個明確和相關(guān)的主題,每個都根據(jù)內(nèi)容進行命名了。

分析

主題模型訓練好之后,算出給定文章的不同主題的權(quán)重就很容易了:

- 使用存儲的TF-IDF模型將文章文本向量化。

- 算出這個向量和精簡過的NMF主題-詞語矩陣的點積。(1x100k * 100k x 75 = 1 x 75 )

- 結(jié)果向量的75個維度表示這篇文章和75個主題有多相關(guān)。

更難的部分在于決定怎么把這些權(quán)重變成一個能講故事的可視化的形式。如果我只是簡單地將一段時期全部文章的話題權(quán)重加起來,這個分布應該是一個關(guān)于那段時間中每個主題出現(xiàn)頻率的準確表達。但是,這個分布的組成部分對人類來說毫無意義。換種方式想,如果我對每個主題做一個二分分類,我就能算出一段時間內(nèi)和一個主題相關(guān)的文章百分數(shù)。我選擇了這個方法因為它更能說明問題。

話題二分分類也有難度,尤其是這么多文章和話題的情況下。一些文章在很多主題下都有更高的權(quán)重,因為他們比較長并且包含的關(guān)鍵詞出現(xiàn)在不同主題里。其他一些文章在大多主題下權(quán)重都很低,即使人工判斷都能發(fā)現(xiàn)它的確和某些主題相關(guān)。這些差別決定了固定權(quán)重閾值不是一個好的分類方法;一些文章屬于很多主題而一些文章不屬于任何主題。我決定將每篇文章分類到權(quán)重最高的三個主題下。盡管這個方法不完美,它還是能提供一個很好的平衡來解決我們主題模型的一些問題。

可視化

盡管數(shù)據(jù)獲取,主題模型和分析階段對這個項目都很重要,它們都是為最終可視化服務的。我努力平衡視覺吸引力和用戶交互,讓用戶可以不需指導地探索和理解主題的趨勢。我開始的圖使用的是堆疊的區(qū)塊,后來我意識到簡單的線畫出來就足夠和清晰了。

我使用d3.js來做可視化,它對本項目數(shù)據(jù)驅(qū)動的模式來說正合適。數(shù)據(jù)本身被傳到了網(wǎng)頁上,通過一個包含主題趨勢數(shù)據(jù)的CSV文件和兩個包含主題和文章元數(shù)據(jù)的JSON文件。盡管我不是前端開發(fā)的專家,我還是成功地通過一周的課程學習了足夠的d3,html和css知識,來構(gòu)建一個令人滿意的可視化頁面。

一些有趣的主題

炭疽熱 – 911以后,恐慌情緒籠罩全國。幸運的是,大部分恐慌都是多慮了。2001年晚期的炭疽熱恐慌是一個沒有什么后續(xù)影響的孤立事件,如圖中清晰可見。

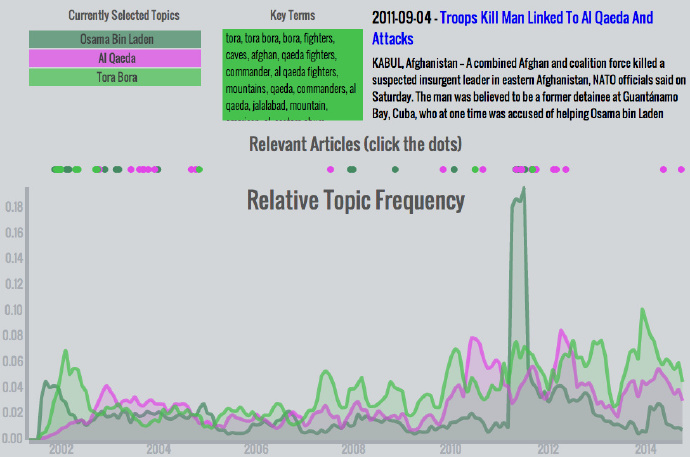

奧薩瑪本拉登,基地組織,托拉博拉 – 所有主題中關(guān)注的峰值發(fā)生在本拉登2011年在阿伯塔巴德被打死之后。這個話題組合值得注意,因為它展現(xiàn)了911事件后媒體關(guān)注的演進:最開始,本拉登獲得了很多關(guān)注。不久后,托拉博拉話題變得突出,因為托拉博拉是疑似本拉登的藏身地點和美軍的關(guān)注重點。當本拉登逃脫了追捕,這兩個話題的關(guān)注下降,而更寬泛的基地組織話題有些提升。近幾年每個話題的逐漸提升說明了它們的關(guān)聯(lián)性。盡管沒有顯著提升,它們相對的關(guān)注度還是在其他話題安靜時有所提升。

我學到了什么

盡管我提出這個項目的時候就對主題模型和數(shù)據(jù)處理中的各個組分有了解,這個項目的真正意義在于它(再次)講出的故事。911事件的本質(zhì)是消極的,但是也有許多積極的故事:許多英雄救了很多人,社區(qū)融合,以及重建。

不幸的是,在我主題模型中展現(xiàn)出來這樣的媒體環(huán)境:關(guān)注負能量、反派和破壞。當然,單獨的一些英雄在一兩篇文章中被贊揚了,但是沒有一個足夠廣來形成一個主題。另一方面,像奧薩瑪·本拉登和卡利亞·穆薩維這樣的反派在很多文章中被提及。即使是理查德·里德,一個笨手笨腳的(試圖)穿炸彈鞋炸飛機的人,都比一些成功的英雄有更持久的媒體影響(一個補充:注重詞匯的主題模型的一個缺點就是,像Reid這樣普通的名字會導致談論不同人物的文章被聚集到一起。在這個例子里,哈利·里德和理查德·里德)。